Одной из ключевых задач в области машинного обучения является настройка весов модели для повышения ее точности. Веса играют важную роль в процессе предсказания модели и их правильное настройка может существенно улучшить ее эффективность.

Настройка весов основывается на анализе и обработке исходных данных, а также на определении роли каждого веса в модели. От правильной настройки весов зависит способность модели к обобщению и ее способность к предсказанию новых данных. Использование неправильных весов может привести к переобучению модели или недообучению, что приведет к низкой точности предсказаний.

Для настройки весов можно использовать различные методы, такие как градиентный спуск, случайный поиск или эволюционные алгоритмы. Каждый из этих методов имеет свои преимущества и недостатки, и выбор метода зависит от конкретной задачи и доступных ресурсов.

Таким образом, настройка весов является важным и сложным этапом работы с моделями машинного обучения. Она требует глубокого понимания данных и модели, а также опыта и экспертизы в области машинного обучения. Правильная настройка весов позволяет достичь высокой точности работы модели и улучшить ее способность к предсказанию новых данных.

Подготовка данных

Для достижения высокой точности работы модели необходимо предварительно подготовить и обработать данные.

В первую очередь, необходимо провести анализ исходных данных. Это позволит выявить возможные проблемы и аномалии, такие как отсутствие данных, выбросы, а также пропуски значений. Отбросьте или заполните пропущенные данные, чтобы избежать искажения результатов обучения модели.

Важным шагом является нормализация данных. При этом приводят данные к единому диапазону значений, чтобы избежать искажений весов модели. Можно использовать методы такие как стандартизация (нулевое среднее и единичное стандартное отклонение) или масштабирование (приведение значений в диапазон от 0 до 1). В зависимости от природы данных выберите наиболее подходящий метод нормализации.

Для улучшения качества данных можно также применить методы аугментации. Это позволит увеличить разнообразие и количество обучающих примеров. Например, можно применять горизонтальное и вертикальное отражение изображений, повороты, изменение размеров и яркости изображения, а также другие трансформации. Это поможет сделать модель более устойчивой к различным условиям и улучшить ее общую производительность.

Важно также разделить данные на обучающую, валидационную и тестовую выборки. Это позволит оценить качество работы модели на новых данных, а также контролировать ее переобучение. Разбиение выборки должно быть случайным и учитывать соотношение классов, если работа идет с задачами классификации.

Предварительная обработка данных является важным этапом при настройке весов модели. Правильно подготовленные данные сыграют ключевую роль в достижении высокой точности и надежности работы модели.

Удаление выбросов

Для выявления и удаления выбросов можно использовать различные статистические методы и алгоритмы. Например, можно применить метод межквартильного размаха, который основан на интерквартильном расстоянии между первым и третьим квартилями данных. Значения, находящиеся за пределами этого размаха, считаются выбросами и могут быть удалены.

Другим методом является использование алгоритма DBSCAN (Density-Based Spatial Clustering of Applications with Noise). Этот алгоритм позволяет выявить группы точек в пространстве данных, а также точки, не принадлежащие к какой-либо группе, которые могут быть выбросами.

После выявления выбросов можно принять различные меры по их удалению. Например, можно просто удалить данные точки из обучающей выборки перед обучением модели. Также можно заменить выбросы на ближайшие значения или использовать методы интерполяции для заполнения пропущенных значений.

Удаление выбросов является важным шагом при настройке весов для повышения точности работы модели. Это позволяет избежать искажений результатов и более точно оценить качество модели на реальных данных.

Работа с пропущенными значениями

При работе с данными зачастую возникает проблема пропущенных значений. Пропуски могут возникать по разным причинам, например, из-за ошибок при сборе или записи данных. Однако, пропущенные значения могут существенно влиять на точность работы модели и анализ данных.

Для работы с пропущенными значениями можно использовать различные методы:

1. Удаление строк или столбцов с пропущенными значениями. Этот метод прост и быстр, но может привести к потере значительного объема данных и искажению общей картины.

2. Заполнение пропущенных значений средним, медианой или модой. Среднее значение часто используется для числовых данных, медиана - для данных с выбросами, мода - для категориальных данных. Однако, заполнение пропусков таким образом может исказить распределение данных.

3. Использование моделей машинного обучения для заполнения пропущенных значений. Этот метод требует больше вычислительных ресурсов, но позволяет получить более точные прогнозы.

Часто рекомендуется комбинировать различные методы для работы с пропущенными значениями, чтобы минимизировать их влияние на результаты анализа данных и моделирования.

| Метод | Преимущества | Недостатки |

|---|---|---|

| Удаление | - Прост и быстр - Не исказит данные | - Потеря значительного объема данных - Искажение общей картины |

| Заполнение средним/медианой/модой | - Прост в реализации - Сохраняет структуру данных | - Искажение распределения данных |

| Использование моделей машинного обучения | - Более точные прогнозы - Сохраняет структуру данных | - Требует больше вычислительных ресурсов |

Выбор модели

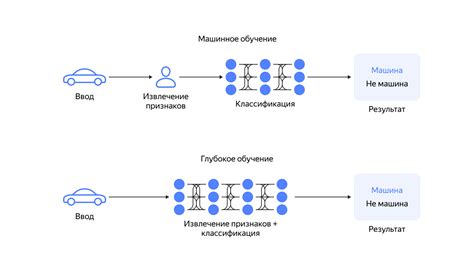

Для начала настройки весов можно выбрать модель, которая показывает хорошие результаты на схожих задачах. Это может быть модель, разработанная и адаптированная для конкретного вида данных, например, изображений или текстовых данных. Большим преимуществом такого выбора является возможность использования предобученных весов, которые уже содержат определенное количество информации о связях между данными.

Другим подходом к выбору модели является анализ различных архитектур и глубин моделей, которые показывают высокую точность на схожих задачах. Это может быть достигнуто с помощью исследования научных статей, блогов и отзывов от опытных специалистов в области машинного обучения.

Однако важно помнить, что выбор модели может быть субъективным и зависит от конкретной задачи, предметной области и доступных ресурсов. Иногда лучшим подходом может быть создание собственной модели или модификация существующей с целью адаптации к конкретным требованиям задачи.

| Факторы выбора модели: | Примеры |

|---|---|

| Количество данных | Небольшое количество данных может требовать использования моделей с малым количеством параметров, чтобы избежать переобучения |

| Разнообразие данных | Если данные имеют сложную структуру или существуют различные классы, может потребоваться использование моделей с более глубокими архитектурами |

| Вычислительные возможности | Если доступные вычислительные ресурсы ограничены, может быть целесообразно выбирать модели с меньшим количеством слоев или параметров |

| Доступные ресурсы | Если доступны предобученные модели или модели с открытым исходным кодом, их можно использовать в качестве отправной точки для настройки весов |

Определение алгоритма

При определении алгоритма необходимо учесть цель и задачи моделирования, а также особенности данных. Важно провести анализ данных, чтобы лучше понять, какие моменты нужно учесть при настройке весов и подобрать наиболее эффективные методы.

Для правильного определения алгоритма можно также использовать методы кросс-валидации или подбора гиперпараметров. Кросс-валидация позволяет оценивать работу модели на независимой выборке данных, а подбор гиперпараметров позволяет оптимизировать работу модели путем настройки ее наиболее важных параметров.

После определения алгоритма можно приступать к настройке весов модели и проведению обучения. В ходе обучения модель будет улучшать свои результаты и становиться более точной и эффективной.

Выбор гиперпараметров

Выбор правильных значений для гиперпараметров играет важную роль в улучшении обобщающей способности модели. Гиперпараметры могут включать в себя такие параметры как скорость обучения (learning rate), количество эпох (epochs), размер батча (batch size) и многие другие.

Подходящий выбор гиперпараметров позволяет найти баланс между недообучением и переобучением модели. Недообучение происходит, когда модель не обладает достаточной сложностью для того, чтобы выучить сложные закономерности в данных. Переобучение, в свою очередь, возникает, когда модель слишком хорошо запоминает обучающие данные, но плохо обобщает на новые данные.

Для выбора оптимальных значений гиперпараметров можно использовать различные методы, такие как сеточный поиск, случайный поиск, оптимизация на основе алгоритмов оптимизации и другие. Важно также учесть особенности конкретной задачи и выбрать гиперпараметры, которые соответствуют ее специфике.

В результате правильного выбора гиперпараметров модель может достичь высокой точности работы и демонстрировать хорошую способность к обобщению на новые данные. Также важно проанализировать и интерпретировать результаты обучения модели с различными значениями гиперпараметров, чтобы лучше понять влияние каждого параметра на качество работы модели.

Обучение модели

Для достижения высокой точности работы модели необходимо провести процесс обучения. Обучение модели состоит из нескольких этапов:

- Подготовка данных. В этом этапе необходимо создать набор данных, который будет использоваться для обучения модели. Данные должны быть разделены на обучающую выборку и тестовую выборку, чтобы оценить качество модели.

- Выбор архитектуры модели. Необходимо выбрать оптимальную структуру модели, которая будет наилучшим образом соответствовать поставленной задаче.

- Инициализация весов модели. Для начала обучения необходимо инициализировать веса модели случайным образом или использовать предобученные веса.

- Определение функции потерь. Функция потерь позволяет оценить, насколько хорошо модель предсказывает правильные значения. Чем меньше значение функции потерь, тем точнее работает модель.

- Выбор алгоритма оптимизации. Алгоритм оптимизации позволяет обновлять веса модели с целью минимизации функции потерь. Наиболее популярный алгоритм оптимизации - стохастический градиентный спуск.

- Обучение модели. На этом этапе происходит итеративное обновление весов модели на основе подсчета градиентов и применения алгоритма оптимизации.

- Оценка качества модели. После завершения обучения модели необходимо оценить ее качество на тестовой выборке. Для этого используются различные метрики оценки точности.

После успешного обучения модели можно использовать ее для предсказания значений на новых данных. При необходимости можно провести дообучение модели для улучшения ее работы.

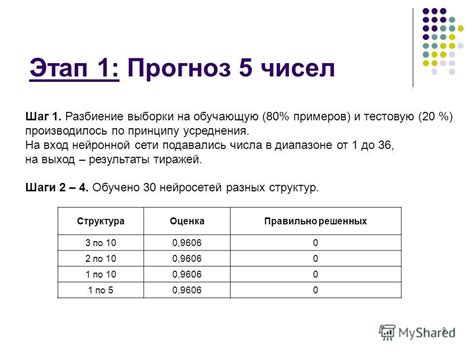

Разбиение на обучающую и проверочную выборки

В процессе обучения модели машинного обучения очень важно иметь надежную оценку ее работы на новых данных, которые она ранее не видела. Для этого обычно используется метод разбиения на обучающую и проверочную выборки.

Обучающая выборка представляет собой набор данных, на которых модель будет обучаться. Эти данные уже имеют информацию о входных признаках и соответствующих им выходных значениях (целевой переменной). Модель будет использовать эти данные, чтобы скорректировать веса своих параметров и научиться предсказывать выходные значения на основе входных данных.

Проверочная выборка, или валидационная выборка, представляет собой набор данных, которые модель ранее не видела и на которых она будет тестироваться. Модель будет использовать свои обученные веса для предсказания выходных значений на этой выборке. Сравнивая предсказанные значения с реальными значениями, можно оценить точность модели и ее способность обобщать знания на новые данные.

Хорошая практика состоит в том, чтобы выборки были разбиты случайным образом, чтобы уменьшить возможность влияния каких-либо особенностей одного конкретного набора данных на результаты модели. Обычно выборки разбивают в пропорции 70-80% на обучающую выборку и 20-30% на проверочную выборку.

Разбиение на обучающую и проверочную выборки позволяет нам оценить, насколько хорошо модель справляется с новыми данными и помогает избежать переобучения, когда модель слишком хорошо запоминает обучающие данные и не может правильно обобщить свои знания на новые данные.

Важно отметить, что разбиение на обучающую и проверочную выборки является лишь одним из способов оценки модели и может быть модифицировано в зависимости от контекста задачи.

Тренировка модели

После настройки весов для повышения точности работы модели необходимо приступить к ее тренировке. Процесс тренировки модели представляет собой итерацию через наборы данных, с целью нахождения оптимальных значений весов.

В ходе тренировки модели используется алгоритм обратного распространения ошибки, который позволяет корректировать веса на каждом шаге. При этом для каждого образца данных модель вычисляет прогнозные значения и сравнивает их с истинными значениями. Разница между прогнозом и истинными значениями называется ошибкой.

Для корректировки весов модели используется градиентный спуск, который позволяет найти минимум ошибки. Градиентный спуск вычисляет градиент функции потерь по весам модели и перемещается в направлении наиболее быстрого убывания ошибки. Таким образом, веса модели корректируются таким образом, чтобы минимизировать ошибку и достичь оптимальной точности предсказаний.

Тренировка модели выполняется на множестве эпох. Эпоха представляет собой полный проход через наборы данных, когда каждый образец данных был использован один раз. В результате каждой эпохи, модель обновляет свои веса и улучшает точность предсказаний.

Однако, при тренировке модели необходимо учитывать возможность переобучения. Переобучение происходит, когда модель можно хорошо обучить на тренировочных данных, но она плохо обобщает свои знания на новые данные. Для предотвращения переобучения модели, часто используются методы регуляризации, такие как L1 и L2 регуляризация.

| Преимущества тренировки модели | Недостатки тренировки модели |

|---|---|

| Улучшение точности предсказаний | Возможность переобучения модели |

| Адаптация модели под данные | Необходимость подбора оптимальных параметров |

| Улучшение обобщающей способности модели | Время и ресурсоемкость процесса тренировки |